Mistral AI es la startup francesa que apostó por la eficiencia antes que DeepSeek. Su futuro es incierto

Mistral AI es la joya tecnológica francesa. La startup de IA se ha convertido en prácticamente la única representante europea que compite con las grandes empresas y las startups tecnológicas en EEUU o China. Lo hace además con un foco absoluto en la eficiencia, que es justo lo que ahora tanto se valora de DeepSeek. Sin embargo, su futuro es complejo. Una startup europea prometedora. Cuando hablamos de ella por primera vez en 2023 sorprendía que sin tener producto alguno logró recaudar 105 millones de euros de inversión. Pronto, eso sí, comenzarían a aparecer los frutos de tal apuesta, lo que además generó que la firma levantase más rondas de financiación. En Xataka Large 2 es el nuevo modelo de lenguaje de Mistral. Es una oda europea a la eficiencia Eficiencia por bandera. Una de las características definitorias de Mistral AI fue que su trabajo estaba siempre orientado a hacer más con menos. A buscar la eficiencia. La startup, a sabiendas de no poder competir con las Bigt Tech en recursos, siempre ha buscado crear modelos más compactos pero con un gran rendimiento. Lo logró con Large 2 123B, que era tres veces más pequeños que Llama 3.1 405B pero igualaba a superaba a ese modelo y a otros como Claude 3.5 o GPT-4o en algunas métricas. Vuelven a la carga con Small 3 24B. La startup acaba de anunciar la disponibilidad de Small 3 24B, su nuevo modelo "pequeño". En realidad no lo es tanto: se suelen calificar de modelos pequeños aquellos con tamaño entre 1B y 14. Sin embargo, ciertamente es un LLM interesante por una cosa: compite de tú a tú con Llama 3.3 70B –lo último de Meta, casi tres veces más grande–, y lo hace además con una latencia (tiempo que tarda en aparecer cada token) mucho menor. El rendimiento es fantástico. La latencia, si hacemos caso de las pruebas internas de Mistral, fantástica. Contesta tres veces más rápido que el modelo de Meta. Su rendimiento es comparable a GPT-4o mini, y supera también con mucho en latencia a Qwen-2.5 32B, que es algo mejor en algunos benchmarks. Este modelo, eso sí, acaba de tener sucesor con Qwen2.5-Max. Open Source, y datos europeos. Otra de las ventajas de la IA de Mistral es que es una IA Open Source –"Open Weights", más bien– , como Llama, DeepSeek o Qwen. A diferencia de ellos, Mistral es una startup que plantea la gobernanza de datos en la UE, algo que puede ser inertesante para agencias gubernamentales y empresas europeas. Ya se ha visto cómo hay suspicacias sobre dónde acaban los datos de nuestros chats con DeepSeek –Italia está investigando al respecto–, y esta es una opción sin duda llamativa. Usos interesantes. Los desarrolladores de Mistral explican que su modelo es perfecto para asistentes conversacionales, porque en ellos precisamente importa que respondan rápidos. Además destacan la capacidad de personalizar/pulir el modelo para que se especialice en ciertas tareas como consejo legal, diagnóstico médico o soporte técnico. El modelo está disponible en plataformas como Hugging Face, pero también se puede ejecutar en local en veriones cuantizadas si tienes al menos una 4090 o por ejemplo un Macbook con 32 GB de memoria. De momento no parece estar disponible en Le Chat, el servicio web que nos ha confesado estar basado de momento en Mistral Large 2.1. En Xataka "El objetivo no es competir con ChatGPT": hablamos con los creadores de ALIA, la IA 100% española, para entender su futuro Modelo de razonamiento a la vista. Pero mientras sus competidores se lanzan de cabeza a la carrera por los modelos de razonamiento, Mistral se ha quedado algo rezagada en este ámbito. En un mensaje en X sí aclaran que Small 3 no hace uso de datos sintéticos "lo que lo convierte en una base estupenda para cualquier cosa en razonamiento". En su anuncio oficial van más allá y señalan que "entre otras muchas cosas, en las próximas semanas se esperan modelos Mistral grandes y pequeños con mayor capacidad de razonamiento". DeepSeek adelantando por la derecha. La startup china de moda se ha convertido en la estrella del momento con sus modelos, y sobre todo con su modelo de razonamiento, DeepSeek R1. Lo ha logrado además usando la misma arma que Mistral: la eficiencia. El éxito de DeepSeek valida la estrategia de Mistral, desde luego, pero la pregunta es si Mistral logrará seguir compitiendo o se verá arrollada por las startups chinas y de EEUU si ellas también adoptan parcial o totalmente ese mismo enfoque. La cuota de mercado de Mistral es modesta, pero corre el peligro de reducirse con la fuerte competencia de empresas de EEUU y China. Fuente: FT. Dudas sobre el futuro. En medios como Financial Times se habla de la preocupación por el futuro de Mistral y de las startups de IA europeas. No hay ninguna otra que trabaje en LLM –la a

Mistral AI es la joya tecnológica francesa. La startup de IA se ha convertido en prácticamente la única representante europea que compite con las grandes empresas y las startups tecnológicas en EEUU o China. Lo hace además con un foco absoluto en la eficiencia, que es justo lo que ahora tanto se valora de DeepSeek. Sin embargo, su futuro es complejo.

Una startup europea prometedora. Cuando hablamos de ella por primera vez en 2023 sorprendía que sin tener producto alguno logró recaudar 105 millones de euros de inversión. Pronto, eso sí, comenzarían a aparecer los frutos de tal apuesta, lo que además generó que la firma levantase más rondas de financiación.

Eficiencia por bandera. Una de las características definitorias de Mistral AI fue que su trabajo estaba siempre orientado a hacer más con menos. A buscar la eficiencia. La startup, a sabiendas de no poder competir con las Bigt Tech en recursos, siempre ha buscado crear modelos más compactos pero con un gran rendimiento. Lo logró con Large 2 123B, que era tres veces más pequeños que Llama 3.1 405B pero igualaba a superaba a ese modelo y a otros como Claude 3.5 o GPT-4o en algunas métricas.

Vuelven a la carga con Small 3 24B. La startup acaba de anunciar la disponibilidad de Small 3 24B, su nuevo modelo "pequeño". En realidad no lo es tanto: se suelen calificar de modelos pequeños aquellos con tamaño entre 1B y 14. Sin embargo, ciertamente es un LLM interesante por una cosa: compite de tú a tú con Llama 3.3 70B –lo último de Meta, casi tres veces más grande–, y lo hace además con una latencia (tiempo que tarda en aparecer cada token) mucho menor.

El rendimiento es fantástico. La latencia, si hacemos caso de las pruebas internas de Mistral, fantástica.

El rendimiento es fantástico. La latencia, si hacemos caso de las pruebas internas de Mistral, fantástica.

Contesta tres veces más rápido que el modelo de Meta. Su rendimiento es comparable a GPT-4o mini, y supera también con mucho en latencia a Qwen-2.5 32B, que es algo mejor en algunos benchmarks. Este modelo, eso sí, acaba de tener sucesor con Qwen2.5-Max.

Open Source, y datos europeos. Otra de las ventajas de la IA de Mistral es que es una IA Open Source –"Open Weights", más bien– , como Llama, DeepSeek o Qwen. A diferencia de ellos, Mistral es una startup que plantea la gobernanza de datos en la UE, algo que puede ser inertesante para agencias gubernamentales y empresas europeas. Ya se ha visto cómo hay suspicacias sobre dónde acaban los datos de nuestros chats con DeepSeek –Italia está investigando al respecto–, y esta es una opción sin duda llamativa.

Usos interesantes. Los desarrolladores de Mistral explican que su modelo es perfecto para asistentes conversacionales, porque en ellos precisamente importa que respondan rápidos. Además destacan la capacidad de personalizar/pulir el modelo para que se especialice en ciertas tareas como consejo legal, diagnóstico médico o soporte técnico. El modelo está disponible en plataformas como Hugging Face, pero también se puede ejecutar en local en veriones cuantizadas si tienes al menos una 4090 o por ejemplo un Macbook con 32 GB de memoria. De momento no parece estar disponible en Le Chat, el servicio web que nos ha confesado estar basado de momento en Mistral Large 2.1.

Modelo de razonamiento a la vista. Pero mientras sus competidores se lanzan de cabeza a la carrera por los modelos de razonamiento, Mistral se ha quedado algo rezagada en este ámbito. En un mensaje en X sí aclaran que Small 3 no hace uso de datos sintéticos "lo que lo convierte en una base estupenda para cualquier cosa en razonamiento". En su anuncio oficial van más allá y señalan que "entre otras muchas cosas, en las próximas semanas se esperan modelos Mistral grandes y pequeños con mayor capacidad de razonamiento".

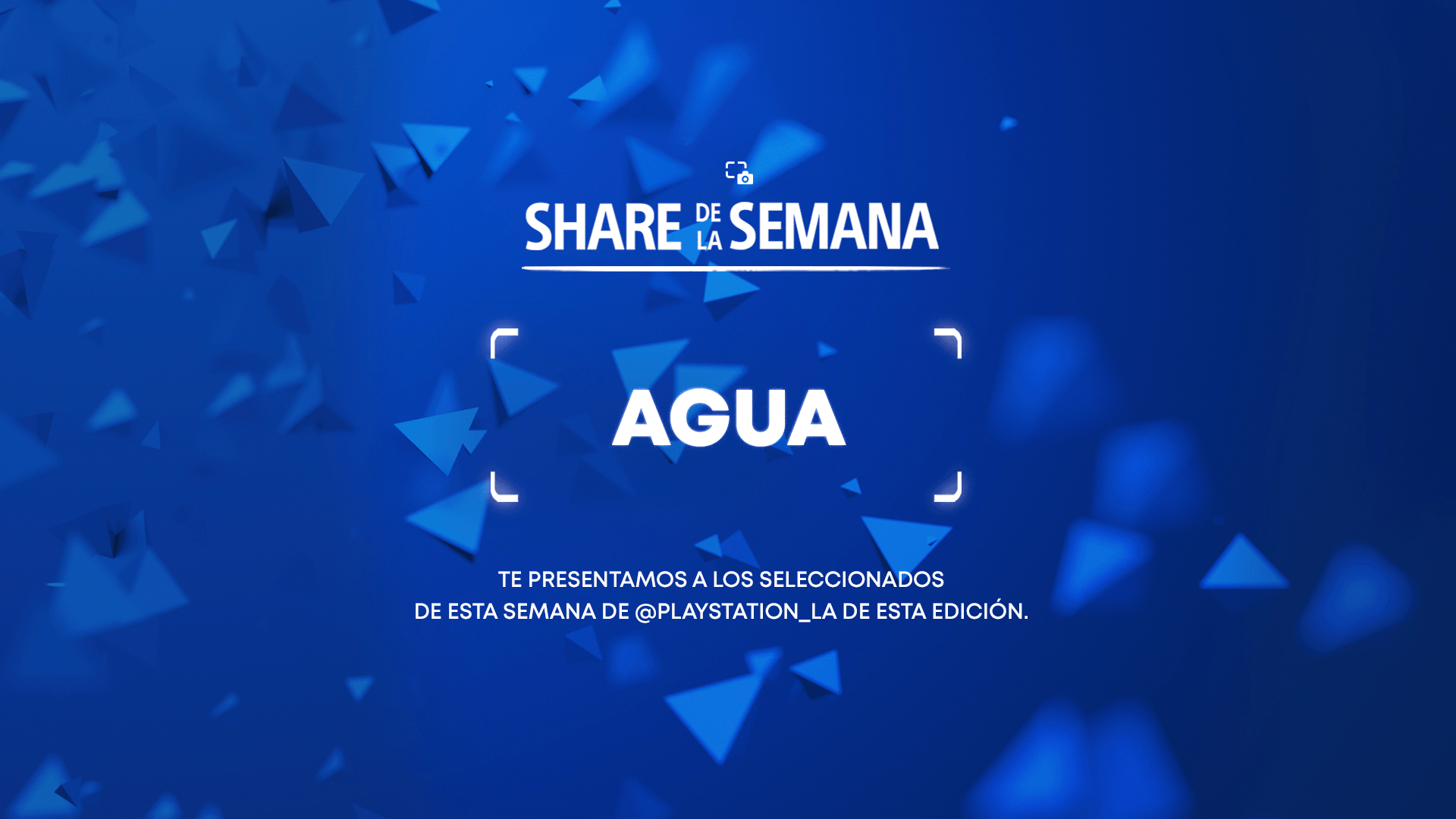

DeepSeek adelantando por la derecha. La startup china de moda se ha convertido en la estrella del momento con sus modelos, y sobre todo con su modelo de razonamiento, DeepSeek R1. Lo ha logrado además usando la misma arma que Mistral: la eficiencia. El éxito de DeepSeek valida la estrategia de Mistral, desde luego, pero la pregunta es si Mistral logrará seguir compitiendo o se verá arrollada por las startups chinas y de EEUU si ellas también adoptan parcial o totalmente ese mismo enfoque.

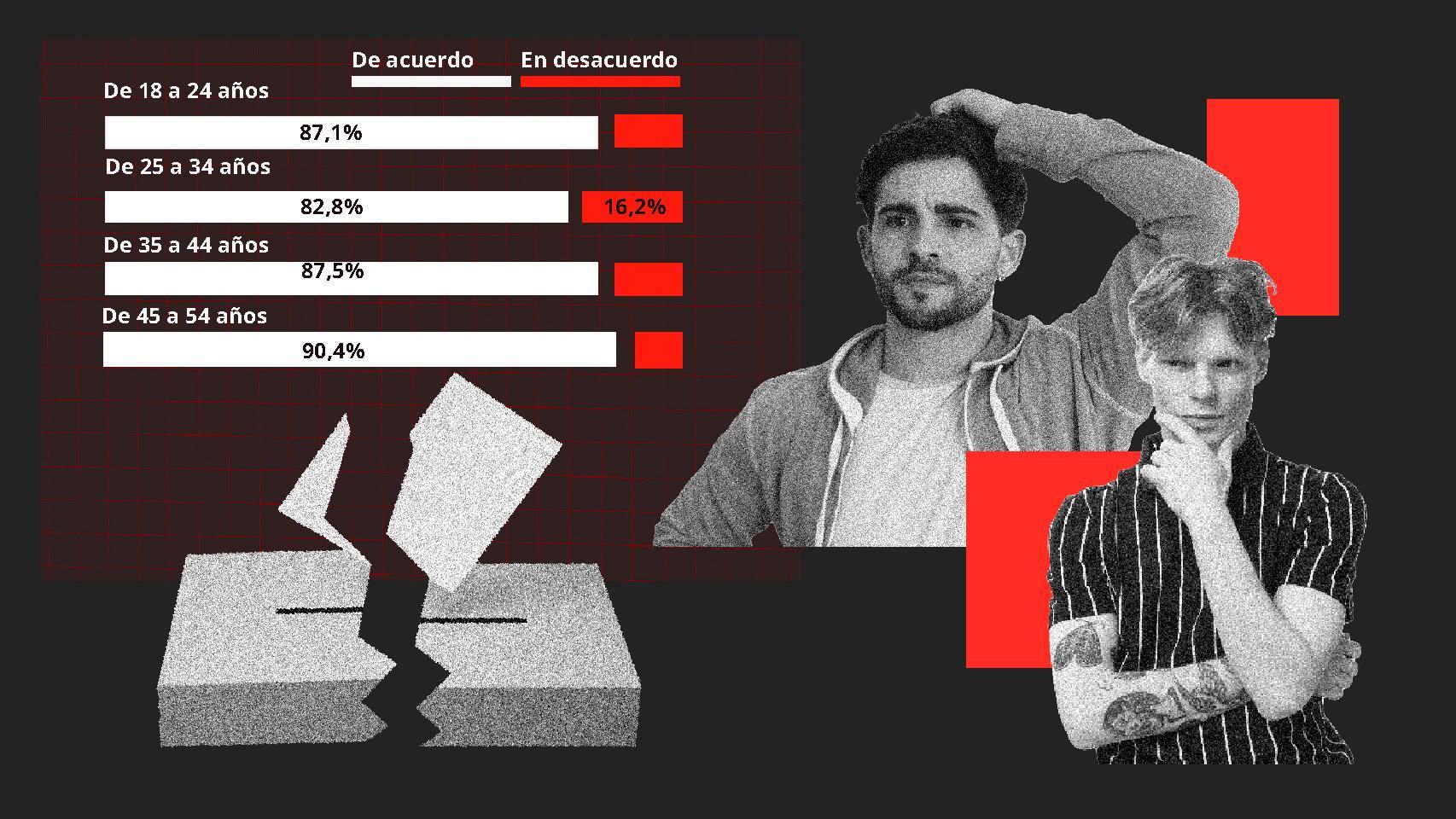

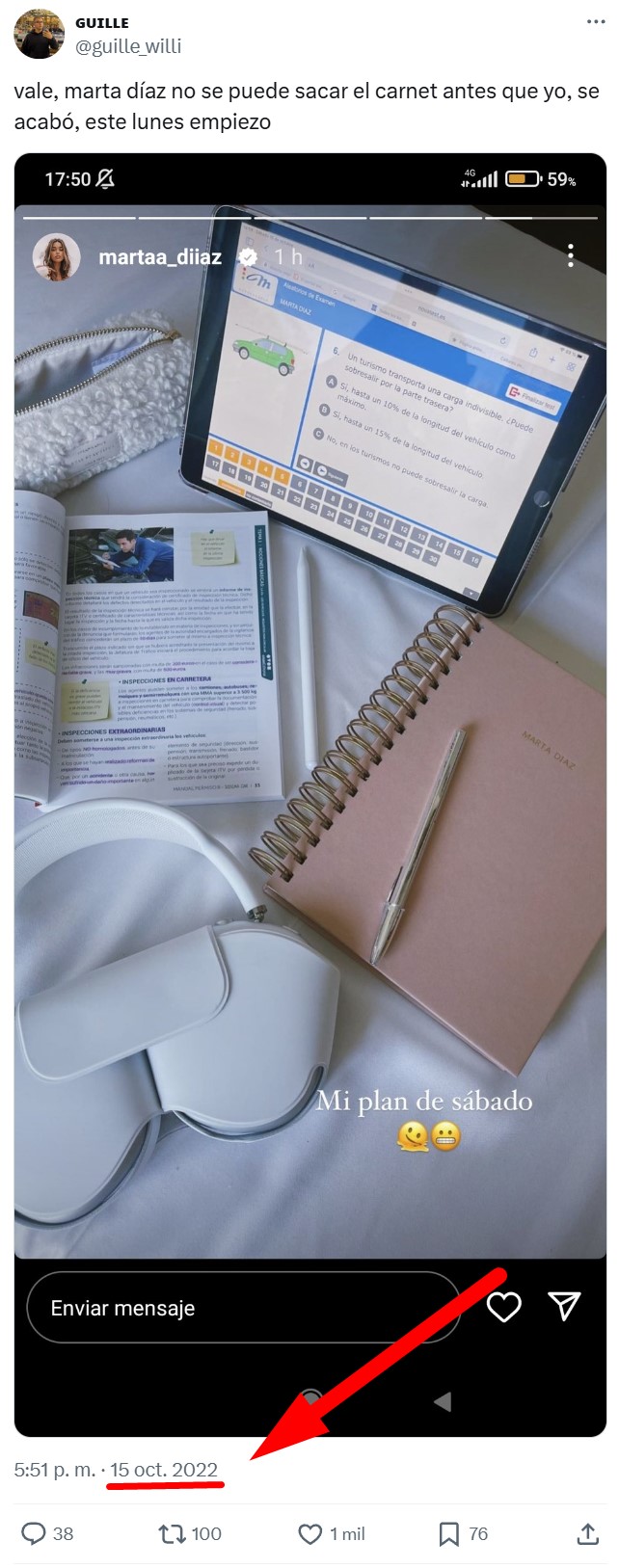

La cuota de mercado de Mistral es modesta, pero corre el peligro de reducirse con la fuerte competencia de empresas de EEUU y China. Fuente: FT.

La cuota de mercado de Mistral es modesta, pero corre el peligro de reducirse con la fuerte competencia de empresas de EEUU y China. Fuente: FT.

Dudas sobre el futuro. En medios como Financial Times se habla de la preocupación por el futuro de Mistral y de las startups de IA europeas. No hay ninguna otra que trabaje en LLM –la alemana Aleph Alpha abandonó esa carrera en septiembre de 2024–, y eso compromete el futuro de los esfuerzos europeos por competir y no depender totalmente de los modelos de China y EEUU por muy Open Source que puedan ser. En España proyectos como ALIA son un primer paso interesante, pero de momento están muy lejos de los LLM y modelos mencionados.

Limbo operativo. Este diario económico también apunta a que con una valoración de 6.000 millones de euros Mistral está en una especie de limbo. Ha levantado demasiado dinero para desaparecer gradualmente, pero no lo suficiente para competir con las megaempresas de EEUU, por ejemplo.

¿Acquihire en el horizonte? Sean Maher, de la consultora Entext, cree que mistral puede seguir los pasos de Inflection AI, que fue adquirida por Microsoft –Mustafa Suleyman, actual máximo responsable de IA en Redmond, fue su cofundador–. Así pues, una potencial adquisición de sus recursos y sobre todo de su talento (lo que se suele denominar 'acquihire') no está descartada.

Imagen | Mistral AI

-

La noticia

Mistral AI es la startup francesa que apostó por la eficiencia antes que DeepSeek. Su futuro es incierto

fue publicada originalmente en

Xataka

por

Javier Pastor

.