Esta IA de código abierto es tan potente como ChatGPT-o1, pero solo cuesta el 3%

Hasta ahora, Estados Unidos reinaba sin rival en el mercado de la inteligencia artificial. Aunque proyectos como Mistral en Francia o algunas iniciativas chinas intentaban romper el monopolio, ninguna lograba igualar la potencia de ChatGPT-o1, el buque insignia de OpenAI. Un dominio que parecía consolidarse aún más con el Proyecto Stargate, la alianza entre Donald Trump y Silicon Valley para invertir 500.000 millones de dólares en infraestructuras de IA. Pero el guion ha cambiado: DeepSeek R1, un modelo chino de código abierto, no solo iguala a ChatGPT-o1 en rendimiento, sino que lo hace con un coste operativo de entre el 3% y el 5%, según TechEBlog.DeepSeek: código abierto, eficiencia... y una lección de humildad para OccidenteLas comparativas son odiosas, pero en este Benchmark se puede ver perfectamente la cercanía entre ambos modelos de lenguajeDeepSeek no es solo otra IA china. Es una verdadera declaración de intenciones de lo que puede desarrollar el país asiático sin necesidad de un hardware avanzado. Desarrollada por un equipo liderado por Liang Wenfeng y financiada por un fondo de cobertura de Shanghái, esta inteligencia artificial es gratuita, accesible y de código abierto, un enfoque radicalmente opuesto al hermetismo de OpenAI que originalmente era una fundación y ahora es una empresa con ánimo de lucro. Su objetivo no es acumular capital, sino democratizar la tecnología: cualquiera puede estudiar su arquitectura, modificarla o implementarla. Y aquí está la clave: mientras ChatGPT-o1 depende de centros de datos mastodónticos, DeepSeek R1 logra la misma eficacia con una fracción mínima de recursos.¿El secreto? La falta de medios agudizó el ingenio. Desde 2022, China carece de acceso a chips avanzados fabricados con tecnología estadounidense debido a las sanciones comerciales en esta especie de pseudo-Guerra Fría que se está viviendo entre las dos mayores potencias mundiales. Así, el equipo que se puso a trabajar en ello optó por optimizar el software hasta límites insospechados, usando técnicas como la Multi-head Latent Attention (MLA) y la Mixture-of-Experts (MoE), que permiten distribuir tareas entre núcleos de procesamiento con una precisión quirúrgica. El resultado es esa eficiencia que reduce el coste operativo al mínimo.El fin de la era del 'cuanto más grande, mejor'Mientras Occidente persigue la escalada infinita -más datos, más chips, más megavatios, duplicar todo en cada generación-, DeepSeek apuesta por la el refinamiento de la fórmula existente y les está funcionando de una forma increíble. OpenAI gasta millones en entrenar modelos con billones de parámetros, la idea de la IA china es todo lo contrario. Esto no hace que OpenAI sea mucho peor, al contrario, sigue siendo el modelo más potente, pero sigue siendoComo os contábamos en el artículo sobre qué es DeepSeek, el hecho de que sea gratuito y su enfoque universalista hacen que sea bastante interesante. Sobre todo en estos tiempos que corren en el que la búsqueda de monetizar la IA ha hecho que muchos planes se disparen hasta los 200 dólares, como el modelo Pro de OpenAI.El timing de DeepSeek es perfecto porque la industria de la IA enfrenta un dilema existencial: su sed de energía es insostenible. Y es que la IA es una amenaza que consume más electricidad que muchos países, tanto es así que Microsoft y OpenAI evalúan construir mini reactores de fusión nuclear para alimentar sus servidores.La pregunta que se pone sobre la mesa es clara. ¿Seguirá Occidente en la línea del consumo desmedido o apostará en esta ocasión por los parámetros que tantos éxitos le están dando a la IA china? Ciertamente, suena a que la mejor idea es una combinación de ambas: hardware refinado y potente y una mayor limpieza a la hora de trabajar con el código.El artículo Esta IA de código abierto es tan potente como ChatGPT-o1, pero solo cuesta el 3% fue publicado originalmente en Andro4all.

Hasta ahora, Estados Unidos reinaba sin rival en el mercado de la inteligencia artificial. Aunque proyectos como Mistral en Francia o algunas iniciativas chinas intentaban romper el monopolio, ninguna lograba igualar la potencia de ChatGPT-o1, el buque insignia de OpenAI. Un dominio que parecía consolidarse aún más con el Proyecto Stargate, la alianza entre Donald Trump y Silicon Valley para invertir 500.000 millones de dólares en infraestructuras de IA. Pero el guion ha cambiado: DeepSeek R1, un modelo chino de código abierto, no solo iguala a ChatGPT-o1 en rendimiento, sino que lo hace con un coste operativo de entre el 3% y el 5%, según TechEBlog.

DeepSeek: código abierto, eficiencia... y una lección de humildad para Occidente

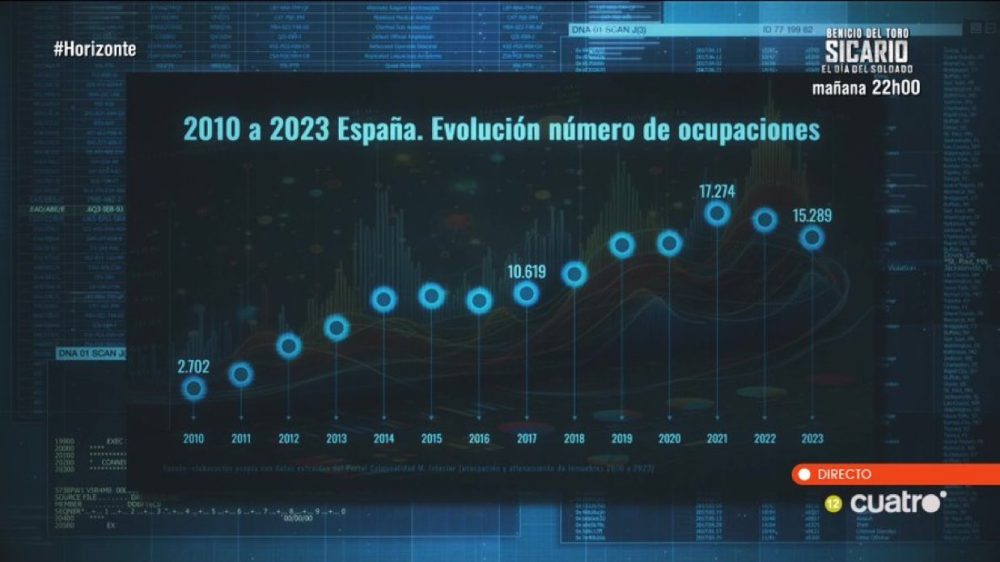

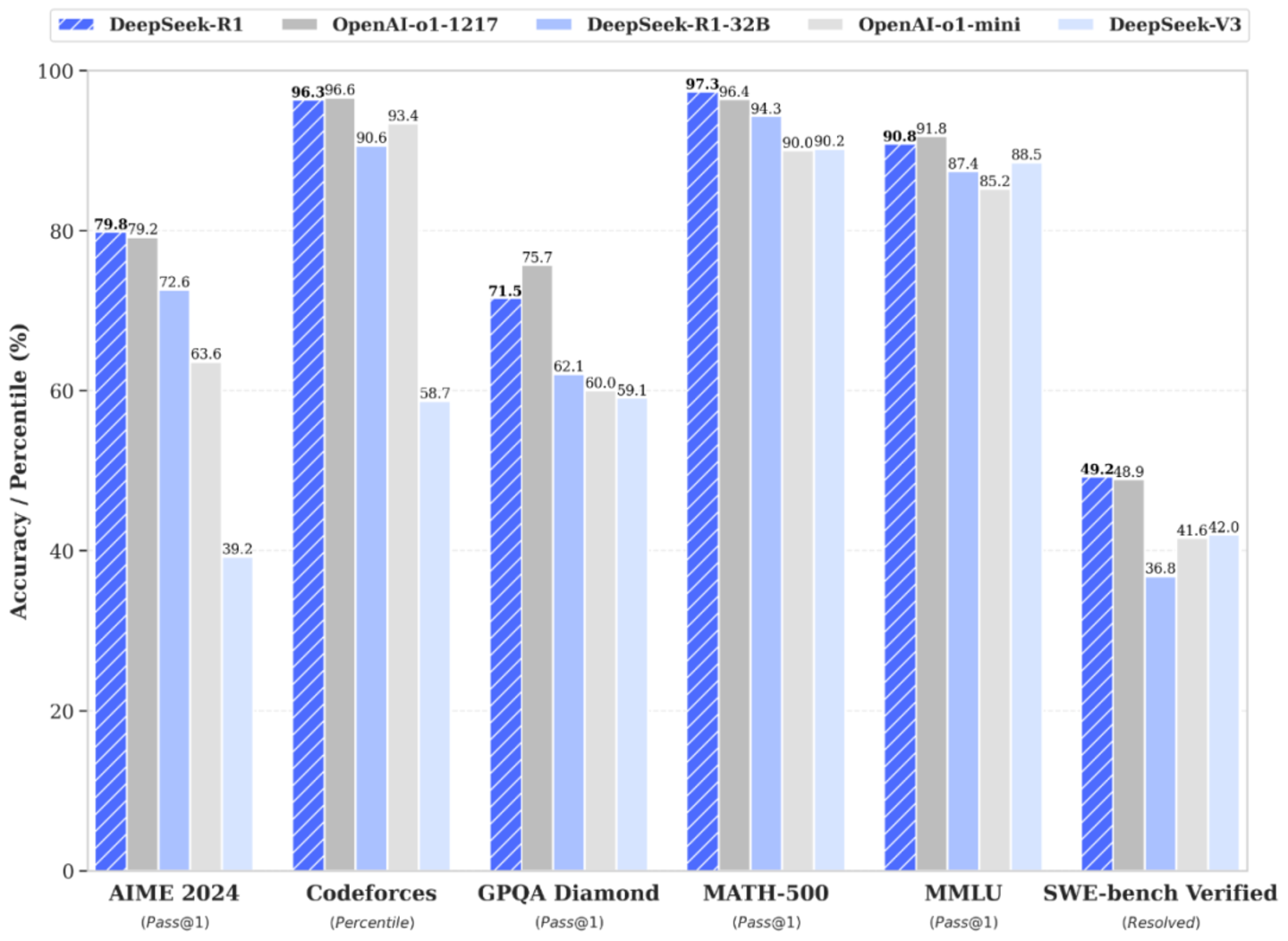

Las comparativas son odiosas, pero en este Benchmark se puede ver perfectamente la cercanía entre ambos modelos de lenguaje

DeepSeek no es solo otra IA china. Es una verdadera declaración de intenciones de lo que puede desarrollar el país asiático sin necesidad de un hardware avanzado. Desarrollada por un equipo liderado por Liang Wenfeng y financiada por un fondo de cobertura de Shanghái, esta inteligencia artificial es gratuita, accesible y de código abierto, un enfoque radicalmente opuesto al hermetismo de OpenAI que originalmente era una fundación y ahora es una empresa con ánimo de lucro. Su objetivo no es acumular capital, sino democratizar la tecnología: cualquiera puede estudiar su arquitectura, modificarla o implementarla. Y aquí está la clave: mientras ChatGPT-o1 depende de centros de datos mastodónticos, DeepSeek R1 logra la misma eficacia con una fracción mínima de recursos.

¿El secreto? La falta de medios agudizó el ingenio. Desde 2022, China carece de acceso a chips avanzados fabricados con tecnología estadounidense debido a las sanciones comerciales en esta especie de pseudo-Guerra Fría que se está viviendo entre las dos mayores potencias mundiales. Así, el equipo que se puso a trabajar en ello optó por optimizar el software hasta límites insospechados, usando técnicas como la Multi-head Latent Attention (MLA) y la Mixture-of-Experts (MoE), que permiten distribuir tareas entre núcleos de procesamiento con una precisión quirúrgica. El resultado es esa eficiencia que reduce el coste operativo al mínimo.

El fin de la era del 'cuanto más grande, mejor'

Mientras Occidente persigue la escalada infinita -más datos, más chips, más megavatios, duplicar todo en cada generación-, DeepSeek apuesta por la el refinamiento de la fórmula existente y les está funcionando de una forma increíble. OpenAI gasta millones en entrenar modelos con billones de parámetros, la idea de la IA china es todo lo contrario. Esto no hace que OpenAI sea mucho peor, al contrario, sigue siendo el modelo más potente, pero sigue siendo

Como os contábamos en el artículo sobre qué es DeepSeek, el hecho de que sea gratuito y su enfoque universalista hacen que sea bastante interesante. Sobre todo en estos tiempos que corren en el que la búsqueda de monetizar la IA ha hecho que muchos planes se disparen hasta los 200 dólares, como el modelo Pro de OpenAI.

El timing de DeepSeek es perfecto porque la industria de la IA enfrenta un dilema existencial: su sed de energía es insostenible. Y es que la IA es una amenaza que consume más electricidad que muchos países, tanto es así que Microsoft y OpenAI evalúan construir mini reactores de fusión nuclear para alimentar sus servidores.

La pregunta que se pone sobre la mesa es clara. ¿Seguirá Occidente en la línea del consumo desmedido o apostará en esta ocasión por los parámetros que tantos éxitos le están dando a la IA china? Ciertamente, suena a que la mejor idea es una combinación de ambas: hardware refinado y potente y una mayor limpieza a la hora de trabajar con el código.

El artículo Esta IA de código abierto es tan potente como ChatGPT-o1, pero solo cuesta el 3% fue publicado originalmente en Andro4all.