Deepfakes, desinformación y el Dividendo del Mentiroso cuando la verdad ya no importa

Los deepfakes han cambiado las reglas del juego, desde políticos que niegan escándalos bajo el pretexto de “es un deepfake” hasta fraudes que arruinan vidas y democracias en crisis. ¿Cómo enfrentamos esta era de desinformación que amenaza nuestras relaciones, decisiones y confianza? Descubre cómo podemos adaptarnos, protegernos y luchar por la verdad en un mundo donde nada es lo que parece. The post Deepfakes, desinformación y el Dividendo del Mentiroso cuando la verdad ya no importa first appeared on El Arte de Presentar.

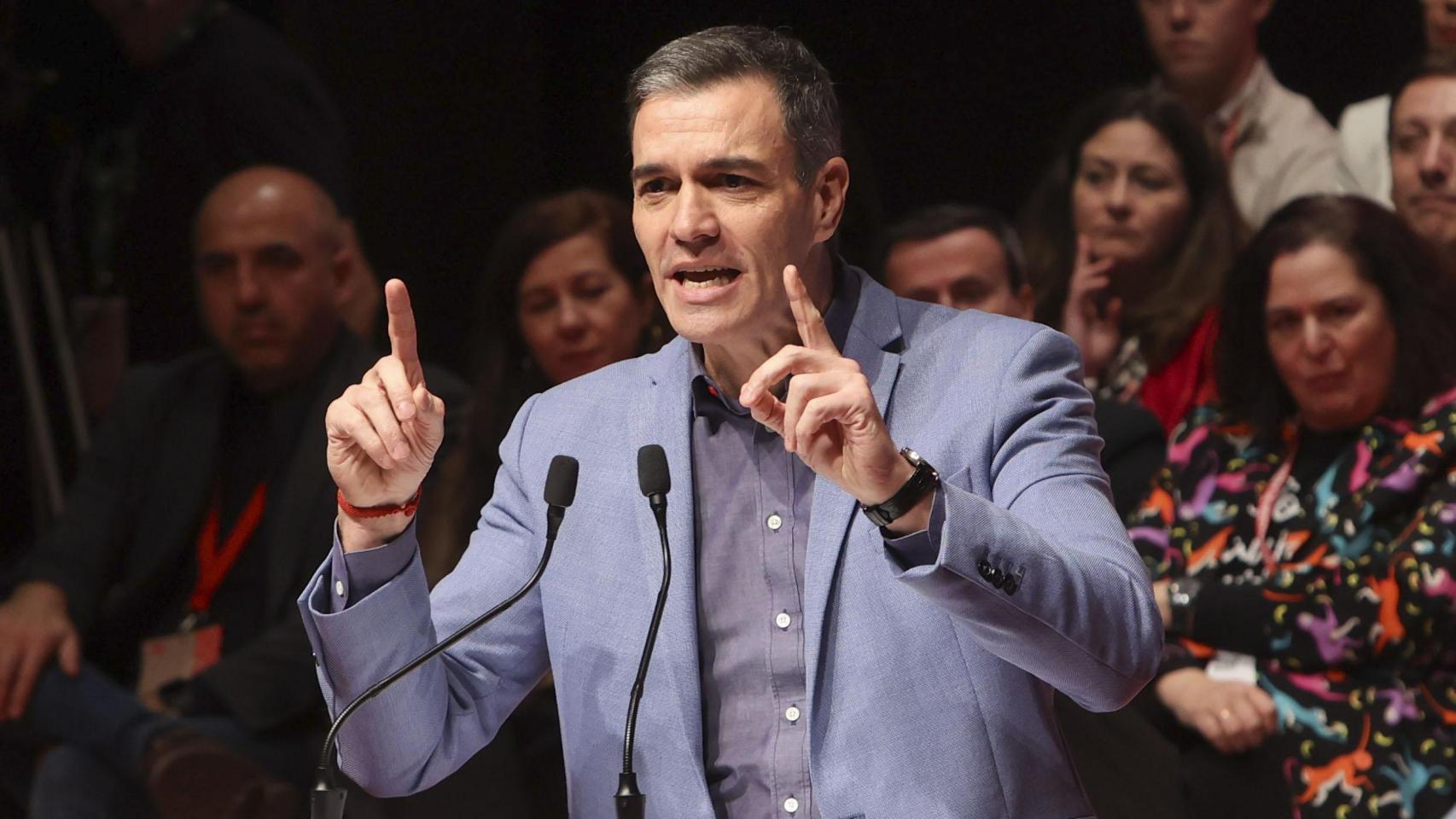

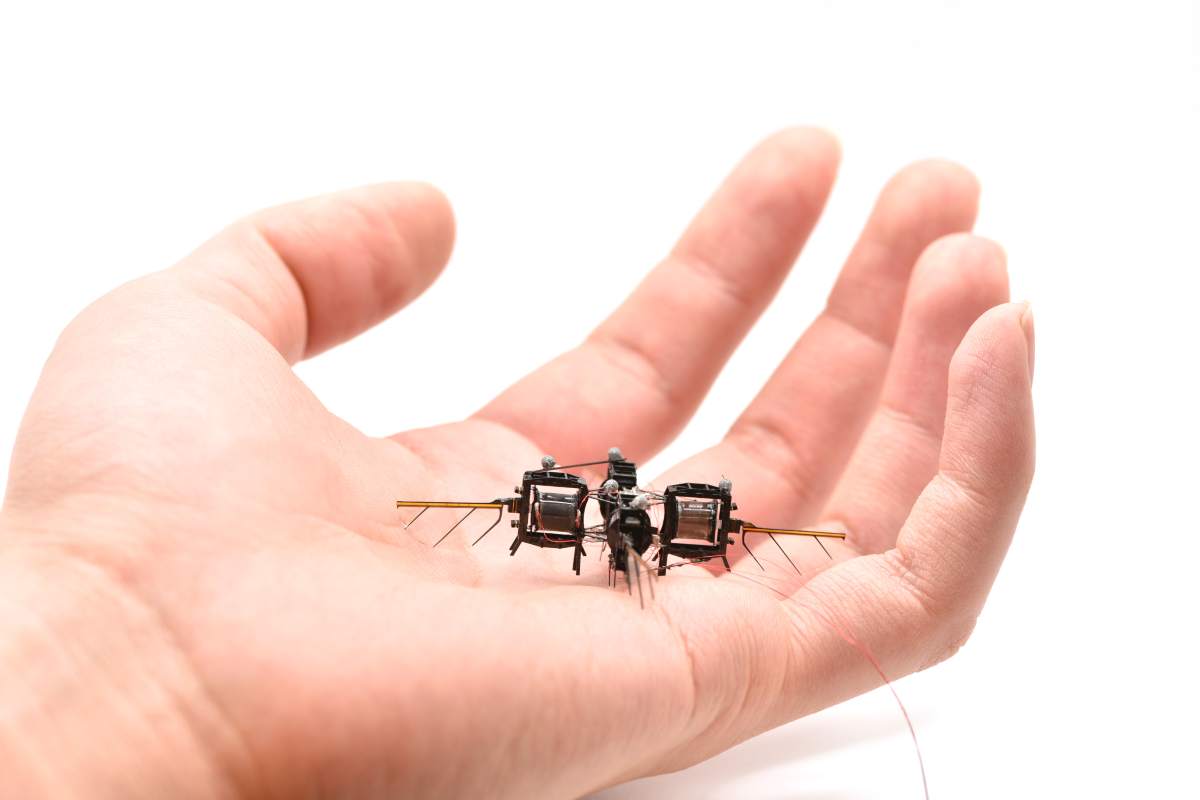

Observa la siguiente foto, ¿qué opinas? ¿Es auténtica o un deepfake generado con IA?

- Real

- Falsa

¿Qué nivel de seguridad tienes en tu respuesta?

Pues sí, es falsa, pero seguro que te lo ha parecido más por el contenido en sí que por su factura técnica. ¿Te imaginas que hubiera sido una instantánea real de un amor furtivo real? Ambos protagonistas podrían escudarse en afirmar que la foto solo era un deepfake generado con IA y bajo el amparo de la mentira prolongar su idilio.

¿Te has preguntado qué pasaría si, en el futuro, ya no pudieras confiar en nada de lo que ves o escuchas? Por desgracia, ese futuro ya está aquí y tiene nombre propio: el Dividendo del Mentiroso (The Liar’s Dividend). Este concepto, que a primera vista parece sacado de un sombrío episodio de Black Mirror, describe un problema que ha emergido con la proliferación de tecnologías de inteligencia artificial generativa como los deepfakes.

El origen del Dividendo del Mentiroso

La expresión Dividendo del Mentiroso fue acuñada por los académicos Danielle Citron y Robert Chesney en su artículo Deep Fakes: A Looming Challenge for Privacy, Democracy, and National Security para describir un fenómeno perverso: a medida que las tecnologías como los deepfakes se vuelven más sofisticadas, los mentirosos pueden utilizarlas para negar la verdad, incluso cuando los atrapen en la mentira. La proliferación de deepfakes exacerbará la descomposición de la verdad, infligiendo daños sustanciales a las personas, las organizaciones y la sociedad, por lo que urge crear soluciones legales, políticas y tecnológicas. ¿Qué podría salir mal?

- Un político corrupto puede desmentir un vídeo incriminatorio alegando que se trata de un deepfake, incluso si el vídeo era real.

- Una figura pública capturada en un audio escandaloso puede evadir responsabilidad con el mismo argumento.

- Hasta tu pareja podría alegar que esa foto dándose el lote con otra persona es puro deepfake.

Esta dinámica surge de la incapacidad de los ciudadanos comunes para distinguir entre lo verdadero y lo falso en un mundo inundado de información manipulada. Y no es una exageración: los deepfakes no solo están mejorando en calidad, sino que se están democratizando, haciendo que cualquiera con una conexión a Internet pueda alterar la realidad. ¿Quién puede vivir en un mundo donde verdad y mentira son indistinguibles? ¿A qué nos aferraremos?

Mentiras, malditas mentiras y deepfakes

No tienes que irte muy lejos para sentir los estragos del Dividendo del Mentiroso. Desde políticos que se escudan en la duda para evadir responsabilidad, hasta campañas de desinformación diseñadas para sembrar caos, esta tecnología está alterando las reglas de juego de la democracia y de las relaciones humanas:

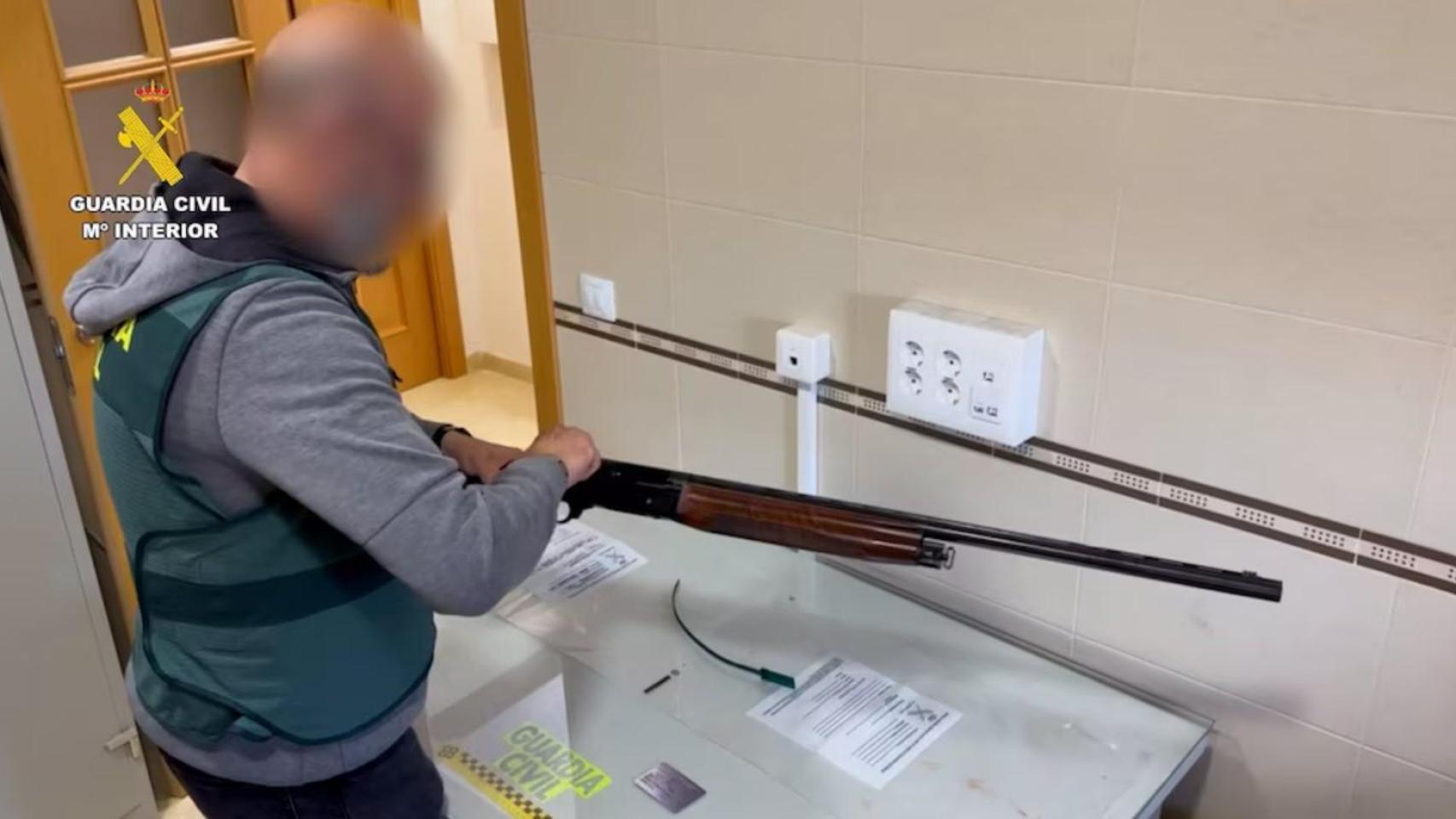

- En política la manipulación de videos y audios ha llevado a escándalos donde es casi imposible determinar la verdad. Por ejemplo, la reciente campaña electoral en EEUU en 2024 se ha visto inundada con vídeos y audios falsos de Biden, Harris y Trump con el fin de confundir a los votantes e inclinar su decisión en el último momento. En marzo de 2022, durante la invasión rusa de Ucrania, se difundió un video manipulado que mostraba al presidente ucraniano, Volodímir Zelenski, instando a sus ciudadanos a rendirse.

- En las relaciones humanas las personas terminan por desconfiar de lo que ven y oyen, incluso de sus propios amigos y familiares. Según Kaspersky, el uso de deepfakes se ha convertido en una amenaza clave en las relaciones personales, donde se crean videos falsos para difamar o manipular a individuos, afectando su vida personal y profesional. Miles de personas se congregaron en Noche Vieja en la plaza de Birmingham esperando un espectáculo de fuegos artificiales que nunca llegó, porque fueron víctimas de un bulo difundido con ayuda de la IA.

- En el crimen crece el uso de los deepfakes para cometer fraudes financieros, extorsiones y difamación. En febrero de 2024, una empresa perdió aproximadamente 24 millones de euros después de que un empleado participara en una videoconferencia con supuestos ejecutivos que resultaron ser deepfakes creados con IA, lo que llevó a la transferencia de fondos a cuentas fraudulentas. Ferrari estuvo al borde de perder una gran suma, pero una pregunta a tiempo evitó el desastre. Figuras públicas como Taylor Swift o Rosalía han sido víctimas de deepfakes pornográficos, donde se utilizan sus imágenes para crear contenido explícito falso, lo que puede dañar su reputación y relaciones personales.

No tengo una bola de cristal, pero no hay que ser adivino para imaginar lo que el futuro nos traerá en este campo

Si crees que estos usos ya son suficientemente preocupantes, ¡agárrate que viene curva! La tecnología sigue evolucionando a pasos agigantados. En poco tiempo, los deepfakes serán indistinguibles de la realidad, no solo para el ojo humano, sino también para los sistemas de detección actuales. ¿Qué pasará cuando nadie pueda confiar en un vídeo o una grabación de audio, ni siquiera en tiempo real? Cuando lo falso sea indistinguible de lo real, lo real será descartado como falso.

- En el ámbito político, podríamos ver democracias debilitadas por líderes que niegan sus crímenes bajo la excusa de “es un deepfake”. Esta situación erosiona la confianza pública y dificulta la rendición de cuentas, lo que podría llevar a un auge del autoritarismo y la manipulación del electorado.

- En la esfera de lo personal, las relaciones humanas podrían enfrentar una crisis de confianza sin precedentes, donde la sospecha permanente envenene la comunicación y el vínculo interpersonal. La incapacidad de confiar en evidencia visual o auditiva podría redefinir los cimientos de nuestras relaciones sociales y familiares.

- En el plano cibercriminal, el fraude y la extorsión alcanzarán niveles inimaginables, exacerbando desigualdades y creando un ambiente de paranoia

En conjunto, esta nueva realidad amenaza con desmantelar la confianza que sustenta nuestras democracias, relaciones y capacidad de discernir la verdad.

¿Hay esperanza?

Aunque el panorama es sombrío, no todo está perdido. Se nos presentan varias estrategias prometedoras que podemos adoptar como sociedad:

- Desde las instituciones: los gobiernos deben desarrollar marcos legales que penalicen severamente la creación y el uso malicioso de deepfakes. También es crucial financiar investigaciones para mejorar las herramientas de detección.

- Desde el mundo académico y la investigación: las universidades y las empresas tecnológicas deben trabajar codo con codo para desarrollar métodos avanzados que puedan autenticar contenido digital. Una primera solución pasará por implementar “marcas de agua digitales” en videos y audios legítimos, así como en los generados por IA. Claro que las herramientas open source para generar deepfakes se saltan todas las restricciones, lo que significa que cualquiera con una buena GPU puede utilizarlas para crear contenido manipulado con fines fraudulentos o desestabilizadores. ¡Todo un reto científico!

- Desde la sociedad civil: las campañas de alfabetización mediática son más importantes que nunca. Enseñar a las personas a cuestionar lo que ven y a verificar la información debe ser una prioridad. Formar y educar en el pensamiento crítico es en tiempos de IA una necesidad más acuciante que nunca antes, como pretendo con esta serie de artículos.

- Empresas privadas: las plataformas como redes sociales y motores de búsqueda deben adoptar políticas más estrictas para identificar y eliminar contenido manipulado antes de que se viralice. Además, las empresas de inteligencia artificial deben incorporar “guardarraíles” en sus herramientas propietarias, incluyendo restricciones en el acceso, marcas de agua digitales y otras estrategias que limiten su uso malintencionado por el público general. Estas medidas no solo ayudarían a combatir el fraude y la desinformación, sino que también aumentarían la confianza en las tecnologías emergentes.

Y yo, ¿qué puedo hacer?

Tú también tienes un papel que jugar. Aquí hay algunas estrategias para protegerte:

- Sé escéptico, pero no cínico: no creas todo lo que ves, pero tampoco asumas que todo es falso. Haz preguntas y verifica las fuentes. Activa el interruptor del pensamiento crítico.

- Aprende a usar herramientas de verificación: hoy en día existen recursos gratuitos para detectar imágenes y videos manipulados. No son perfectos, pero aportan evidencia adicional, como Maldita.es.

- Informa y educa a otros: comparte tus conocimientos sobre pensamiento crítico con tu familia y amigos. Comparte con ellos estos artículos.

La esperanza en la Era de la Desinformación

Es cierto, el Dividendo del Mentiroso pinta un panorama inquietante. Pero hay esperanza. La historia nos muestra que la humanidad siempre encuentra maneras de adaptarse a los cambios tecnológicos. La clave está en educarnos, innovar y, sobre todo, no perder la confianza en nuestra capacidad para superar desafíos.

En última instancia, la verdad importa. Y si trabajamos juntos, podemos construir un futuro en el que la tecnología sea una herramienta para la verdad, no para la mentira. Porque, aunque los mentirosos puedan ganar a corto plazo, la verdad siempre encuentra su camino.

DIÁLOGO ABIERTO

¿Cómo crees que pinta el futuro ante la amenaza de los deepfakes indistinguibles de la realidad?The post Deepfakes, desinformación y el Dividendo del Mentiroso cuando la verdad ya no importa first appeared on El Arte de Presentar.