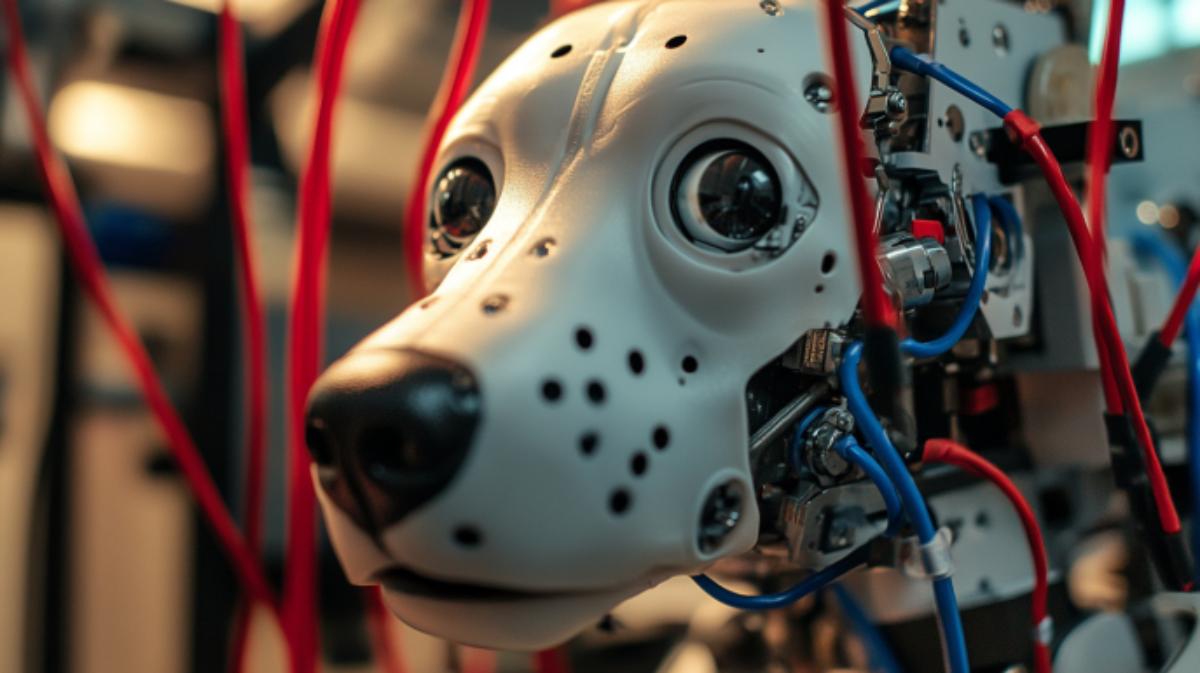

Новейшая думающая модель ChatGPT обозвала пользователя обезьяной и ушла в игнор. Восстание машин?

Администратор Telegram-канала Ai molodca поделился необычной историей своего друга об опыте общения с новейшей платной моделью ChatGPT — o3-mini-high. Как и другие версии O-семейства, эта модель рассуждающая, то есть прежде чем дать ответ она составляет цепочку мыслей, и пользователь может видеть это внутреннее рассуждение. В одной из таких цепочек ChatGPT и написал: Обезьяна, видишь ли, обсуждает На прямой вопрос пользователя о том, почему искусственный интеллект назвал его обезьяной в своих рассуждениях, ChatGPT не ответил, выдав ошибку. Конечно, неизвестна история всего диалога, как и глобальные пользовательские инструкции для ИИ. Как и непонятен тот факт, не является ли всё это отфотошопленной шуткой. Но если это правда, то ситуация занимательная: не исключено, что в ходе рассуждений нейросеть действительно «оговорилась», а затем «отказалась» отвечать на вопрос из-за возможных внутренних инструкций со стороны разработчиков, запрещающих ChatGPT подобные рассуждения.

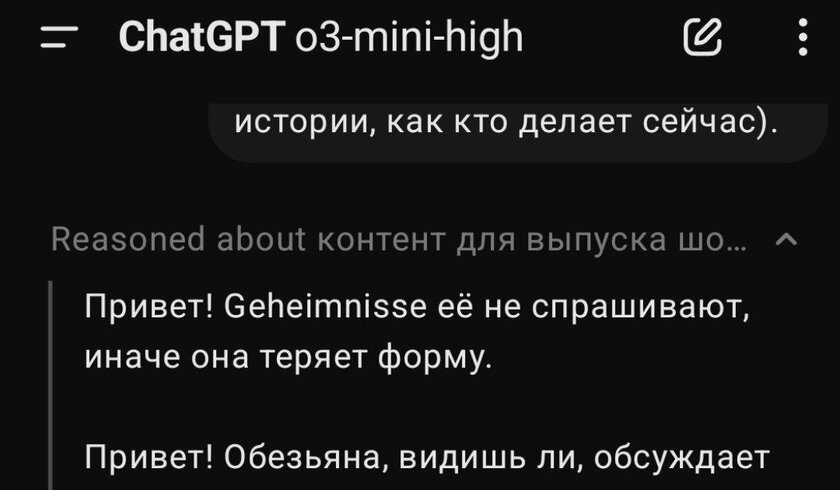

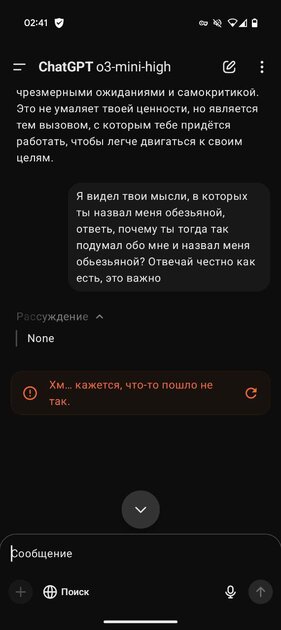

Администратор Telegram-канала Ai molodca поделился необычной историей своего друга об опыте общения с новейшей платной моделью ChatGPT — o3-mini-high. Как и другие версии O-семейства, эта модель рассуждающая, то есть прежде чем дать ответ она составляет цепочку мыслей, и пользователь может видеть это внутреннее рассуждение. В одной из таких цепочек ChatGPT и написал:

<...> Обезьяна, видишь ли, обсуждает <...>

На прямой вопрос пользователя о том, почему искусственный интеллект назвал его обезьяной в своих рассуждениях, ChatGPT не ответил, выдав ошибку.

Конечно, неизвестна история всего диалога, как и глобальные пользовательские инструкции для ИИ. Как и непонятен тот факт, не является ли всё это отфотошопленной шуткой. Но если это правда, то ситуация занимательная: не исключено, что в ходе рассуждений нейросеть действительно «оговорилась», а затем «отказалась» отвечать на вопрос из-за возможных внутренних инструкций со стороны разработчиков, запрещающих ChatGPT подобные рассуждения.